oophus

Medlemmer-

Innlegg

14 078 -

Ble med

-

Besøkte siden sist

-

Dager vunnet

56

Innholdstype

Profiler

Forum

Hendelser

Blogger

Om forumet

Alt skrevet av oophus

-

Det faktum at du blir klaget på litt, er en forandring som Tesla ble tvunget til å gjøre. Det er altså ikke noe de initiellt hadde, og var en av grunnene til at Mobileye avsluttet samarbeidet. Tesla's aksept til å ta risiko mens de kaster ansvaret til deg er altså skyhøy. Prøv nå å se for deg situasjonen du prater om som en forbipasserende syklist, for den syklisten deler også veiene med deg. Det er en grunn til at SAE nivå 2 selvkjøring er blitt diskutert og til og med antatt at ville vært best å hoppe over. Men så lenge vi ikke gjør det, så burde man finne metoder å omgå problemområdene på best mulig måte. En av dem er å sørge for at sjåføren gjør mest mulig av jobben (da sørger man samtidig for at sjåføren faktisk følger med på situasjonene ute og er oppdatert på alt som skjer), og har underliggende systemer som kan "dytte" litt på sjåførens input om den ser at sjåføren ikke plasserer bilen optimalt i veibanen. Blir systemene bedre så vil man hele tiden uansett anta at sjåføren kjører, og man kan fint analysere forskjellene mellom menneskelig ferdsel og hva maskinen selv ville valgt. Man trenger ikke trene på at maskinen selv kjører, den analyserer uansett veiene hele tiden og har egne ideer om hva som ville vært best. Så ender man kjappere frem til nivå 3, hvor ansvaret skifter hender. Men har man en person som Elon Musk som lover at bilene er selvkjørende og at man kun venter på reguleringer som godkjenner deres form for risiko, så havnet vi altså her. Folk prøver å la bilene kjøre for seg, og sammenligner heller dette mot andre nivå 2 systemer. Ping pong som er dårlig, og dårlig "lane sentring" mens man holder hendene fra rattet og ikke utfører DDT (dynamic driving task) selv. Akkurat det SAE J3016 advarte mot.

-

Ja, som beskrevet flere ganger over av flere personer, det stemmer. Aktiver autosteer, ta på solbriller og kos deg. Bilen vil ha null ide om du faktisk kikker ut på veiene over en betydelig lang tid, nok tid i massevis til at du ikke ville ha hatt kontroll over situasjonen utenfor.

-

Les linkene jeg har gitt tidligere i tråden. AP er ikke bra nok for full selvkjøring og faller innunder SAE nivå 2 selvkjøring. FSD er fremdeles på samme stadie, og er fremdeles ikke bra nok til å klassifiseres over nivå 2 selvkjøring.

-

Ja, og da avsluttet mobileye samarbeidet. Tesla hadde en helt annen sikkerhetskultur rundt hvordan mobileye mente at systemet skulle fungere. Rart det der.

-

Over tid så har Tesla fått kjeft av både DMV og NHTSA og har gjort justeringer. Så det er bedre idag enn det var da, men denne saken handler om et uhell som hendte i 2019. Og Tesla har fremdeles for dårlig fører-monitoring når de uansett krever at føreren kun skal monitorere systemet, uten at systemet er implementert slik at det monitorerer føreren. Ergo burde Tesla's fører monitorering være bransjens beste, uten at det er det. Grunnen til at Tesla får kjeft grunnet dette er som sagt testene man har gjort på det, og vi vet helt fra 50 tallet at vi er utrolig dårlige på å gjøre den oppgaven som Tesla ønsker at vi skal utføre. Vi klarer ikke å holde fokus over tid når vi kun skal "passe på" et system, og det blir verre jo bedre et slikt system blir innenfor nivå 2 SAE selvkjøring. SAE J3016 argumenterte i sin tid for å forby nivå 2 av denne grunnen rundt problematikken, men fant ut at man kunne gjøre det motsatte. Altså sette systemet i bakgrunnen og la mennesket være sjåførene innunder dette nivået. Ergo er det blitt slik at samtlige som nå tilbyr SAE nivå 2, har dette systemet underliggende mennesket. Det er kun Tesla som ikke gjør det.

-

Bruk gjerne et minutt eller to på å gjøre et forsøk. Eventuelt så er jeg interessert i å vite hva du mener om saken om du i et lite sekund kan i hvertfall late som om det jeg har funnet frem til deg er korrekt. Burde Tesla hvis vitenskapen er rett, justere seg, eller vil du fremdeles at de skal holde på som de gjør?

-

Du bryr deg ikke om vitenskap og hva den sier hvis man fortsetter som man gjør? Vitenskapen sier at det vil være flere uhell, og uhellene vil bli verre fordi systemene som oftest brukes i høyere hastigheter. Sverreb har også lagt inn kilde på at Tesla'ene som jo burde være en av de sikrere bilene ifølge deg og dere nå raver i toppen av dødsstatestikken. Det bryr du det ikke noe om? Er det ikke en litt egoistisk egenskap å ville beholde noe slik det er kun fordi du liker det slik, selv om du vet at det vil gjøre veiene mindre trygge?

-

Fremdeles null due diligence fra dere til hvem som betaler for å reklamere på denne siden ser jeg. Svindel og scam har tydeligvis vært greit her over flere år?

-

Hvorfor kjører ikke du aktivt og holder bilen i midten av veibanen om det er en av de små veiene der oppe uten midtdeler? Svar så på resten av det jeg skrev om monitorering. Det er haugevis av tester som beviser at vi er dårlige på det, så hvorfor skal vi på død og liv kun følge med på et førersystem når vi vet vi er dårlige på det? Jo bedre det blir, jo verre blir vi på å følge med, og stygge utfall blir et naturlig resultat av det.

-

Det betyr at du vingler rundt på veiene. Er det slik du kjører? Du har rett og slett kjørt en bil med kun "Lane Keep Assist" og antatt at den har mer funksjoner enn den har hatt, også skal vi late som om det er umulig at folk som kjører Tesla antar at bilen kan mer enn den kan. Du er jo beviset her alene på at folk bruker bilene og systemene feil da isåfall... Nei, det er ingenting rundt Autosteer som krever at du følger med for at det fungerer, og der ligger også problemet. Det er ikke en assist for å gjøre deg til en bedre sjåfør. Det er et system som later til å skulle fungere som en robtaxi. Det gjør deg til en observatør, men gjett hva - vi mennesker er ekstremt dårlige på den oppgaven. Vi suger på å skulle kun følge med på et system. Og dette er ikke noe vi har funnet ut av nå nylig. Vigilance (psychology) - Wikipedia Slik ting er noe du selv kan teste hjemme. Be samboeren din sette opp X antall alarmer innenfor Y tid og undersøk hvordan din reaksjonstid er underveis i forsøket. Øk Y tid og sjekk om reaksjonstiden din øker jo lengre det tar mellom alarmene. Hva trur du vil være resultatet, og om resultatet gir et dårligere resutlat om alarmen går sjeldnere, kan dette ha noen effekt for overvåking av en selvkjørende bil trur du? Mer lesestoff: Boring But Demanding: Using Secondary Tasks to Counter the Driver Vigilance Decrement for Partially Automated Driving - Scott Mishler, Jing Chen, 2024 Hvis man på død og liv skal ha mennesker som overvåker systemer, så må vi underholdes for å ikke falle bort. Innunder oppgaven å kjøre bil, så er det åpenbart at på nivå 2 SAE level, så er det mye sikrere at vi underholdes av å aktivt kjøre bilen. Systemene burde da være underliggende oss og passe på oss for at vi ikke gjør feil, og ikke omvendt. På nivå 3 så har vi uansett ikke lengre ansvaret, så her er det plutselig greit å snu ballen rundt, men selv på nivå 3 så skal vi følge med sånn omtrentlig. Nok til å kunne orientere oss og ta over på noen sekunder. Dog det ligger en ekstremt stor forskjell på å orientere oss rundt en situasjon på en brøkdels av et sekund mot flere sekunder.

-

Litt som at AEB er irriterende som bare skrur seg på? Sikkerhetssystemer burde være underliggende kjøringen hele tiden, da det er litt av poenget med dem.

-

AP er ikke nødvendigvis fryktelig ræva, det er implementert på en metode som går mot normale retningslinjer som er definert i SAE J3016 og J3018. Disse veiledende dokumentene som hele tiden oppdateres er dokumentene bransjen i sin helhet (med unntak av Tesla) følger. Når man ved et tidspunkt mener at et system er sikrere på enn av, så burde man inkludere det i sikkerhetssystemene. Om Elon Musk mener at AP er sikrere på enn av, så burde implantasjonen være bedre integrert mot sjåfør. Da er det bilens ODD som aktiverer systemet, der sjåførens oppgave kun er å sette det i "ready to engage" modus. I dag så må bilens ODD være aktivert før man får lov til å aktivere systemet, og om du tar over, selv om bilens ODD fremdeles er i "aktive" modus, så må du selv aktivere systemet fremfor at det går av seg selv.

-

Innunder et sikkerhetssystem så skal du jo egentlig ikke ha særlig med valg rundt det. Det følger litt samme logikk som med setebelte. Om Elon Musk mener at AP er sikrere på enn av, så er det merkelig at det skal være av og at du selv skal bestemme hvor "sikrere" du ønsker å gjøre andre trafikanter rundt deg. Det er uansett slik at ODD avgjør om slikt kan aktiveres eller ikke. En bra definert og testet ODD gir deg muligheten til å ha automatikk i det. Der droppet jo Tesla ballen, og lar den avgjørelsen kun falle til sjåføren. Du sitter galt om du blir mentalt sliten av å ha hendene på rattet. Prøv å fiks sittestillingen din.

-

Ja, jeg tenker på uttalselsene som omhandler sikkerhet, at om noe er mer sikkert med systemet påskrudd eller ikke, så vil det være naturlig at ting alltids er aktivert ved oppstart hvor man kun venter på korrekt ODD før det aktiveres. Hvis ikke så gir ikke slike uttalelser noe særlig med mening.

-

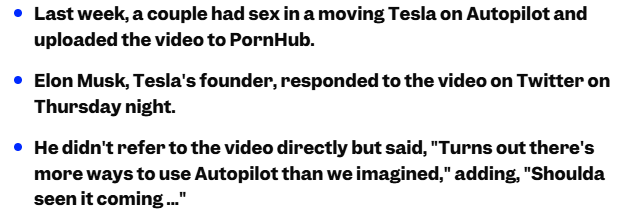

Du må altså rykke litt i rattet for å bevise for Tesla at du følger litt med, eller dvs følger med på en skjerm som maser litt på deg på utsiden av synsfeltet du egentlig skal ha... Samtidig kan du jo forsvare Tesla i deres fremgangsmetode for å undersøke hvorfor uhell har skjedd med AP på:

-

Da går du isåfall imot Elon Musk som mener at autosteer og AP på generell basis gjør veiene sikrere. Du mener altså at systemet gjør veiene mer usikre? Isåfall hva i allverden gjør systemet på veiene i det hele tatt? Aha, det er her vi går på en missforståelse ja. Du vet at du kan aktivere AP der AP egentlig ikke er trent opp til å fungere optimalt. Ergo ville det vært farlig? Du ser kanskje et poeng her, eller? Fordi på en BMW, eller Mercedes så vil systemet alltids være på, og med "på" så menes det at det aktiveres når alt er klart. Det betyr at det ikke er på nødvendigvis når du kjører ut av parkeringsplassen og den første kilometeren om det er midt i byen. Det aktiveres når man typisk er ute på veier med gode veimarkeringer o.l. som jo da typisk vil være ved hovedveiene. Eventuelt så kjapt man står i en kø. Operasjonsområdene er mye bedre definert. Så konklusjonen er at Tesla sin autosteer ikke er et sikkerhetsssystem? Det er et system som "leker" at det er et bedre system en det egentlig er? Om man bruker et system som fordrer et mye bedre samarbeid mellom system og sjåfør, så vet man jo hvilke biler som faktisk havner i grøfta og ikke, for jeg har da vitterlig sett nok av Teslaer i grøftene...

-

Forskjellen ligger i hva som skjer om du avbryter f.eks filbyttet etter å ha igangsatt den. Hos Tesla så skrur alt seg av, og du må aktivere det igjen manuelt. Du må også aktivere assistene manuelt etter å ha startet bilen. Hos Mercedes og BMW så starter man bilen med slike assists påslått. Man må slå det av manuelt, hvis ikke går systemene altid kun i dvalemodus om man gjør justeringer selv. Det betyr at om du aktiverer et filbytte så kan du fint avbryte det før det skjer, eller underveis og systemet slår seg på igjen etterpå uten input. Det i seg selv fordrer en mye bedre sømløs samspill mellom sjåfør og assisten, da man ikke blir "straffet" av å kjøre selv, slik man blir hos Tesla hvor alt går av og må aktiveres manuelt igjen, ofte flere ganger om systemet ikke mener at alle kriterier er klart for AP/FSD på igjen. Det er også veldig stor forskjell mellom motstanden man føler hos en Tesla med autosteer på vs Mercedes eller BMW f.eks. Hos Tesla må man bruke litt kraft, og man må røkke litt i rattet for å ta over og skru av systemene. Hos Mercedes eller BMW så blir det mer naturlig overgang ettersom man ikke trenger å "ratte" hardere enn normalt ved normal ferdsel. Systemet er i bakgrunnen uansett hele tiden uavhengig av om man er aktiv med motstand i rattet hele tiden eller holder lett i det.

-

Basert på den linken der, hvorfor må jeg stryke BMW fra lista? BMW beviser vel her at de gjør denne fremgangsmetoden på helt korrekt metode... Men kan du ikke ramse opp forskjellene mellom "autopilot" for et fly mot en bil da? Hvordan ser trafikkbildet ut der oppe f.eks? Når eksisterte første instans av en autopilot for fly, og når kom første bruk med passasjerer? Hvor mange ganger landet man med "autoland" systemet uten passasjerer, og hvor mange millioner timer ble brukt i simulatorer for en slik landing? Til slutt, kan du finne noen slike systemer som står fast på at man helst kun burde bruke kun én type sensor, og som kastet dette systemet uferdig ut til passasjerfly og testet dette med passasjerer i? Hadde Tesla vært et annet selskap som lagde fly, så hadde det fremdeles vært fremgang selv om flyene stupte i bakken med passasjerer i. Systemet skal jo tross alt bli bedre, og uhell er noe man lærer av... /i Blir man kanskje mindre sliten av å ikke måtte fokusere like mye på veien? Lurer på hvordan det går over tid når millionervis av folk er mindre slitne pga dårlig ADAS der ute. Kanskje du nå kan kjøre i 20 timer i strekk slik piloter gjør? Også reagerer man på at søksmål etter dødsfall får slike utfall..

-

Sannsynlighet er en rar bil...

-

Må du slutte å kødde. Alle sammen har en eller annen feedback til fører at systemet slåes ut midlertidig. Hos de fleste så inkluderer man også HUD sammen med disse litt mer avanserte førerassistene, nettopp for å kunne vise informasjon og status for systemet direkte i synsfeltet. Hva gjorde Tesla? I en lengre periode så slo systemet seg bare av. Det tok sin tid med mye press fra blant annet NHTSA før Tesla gjorde litt grep, steg for steg. Så hvem er det igjen som er late?

-

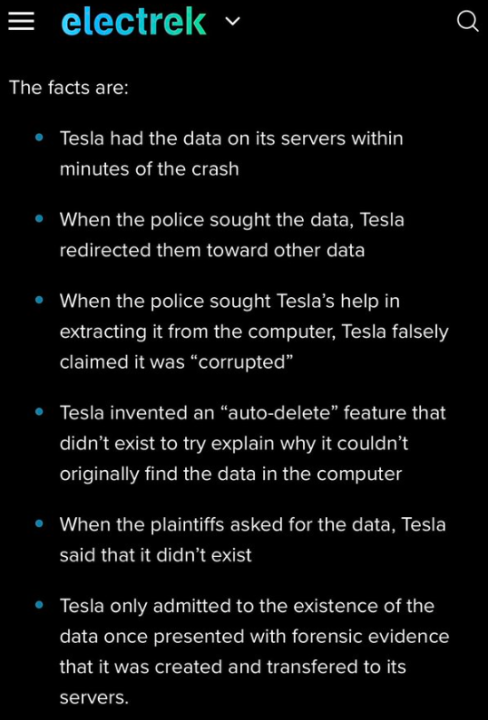

https://electrek.co/2025/08/04/tesla-withheld-data-lied-misdirected-police-plaintiffs-avoid-blame-autopilot-crash/?utm_source=dlvr.it&utm_medium=threads Hvor mye verre kan det egentlig bli? Dere som støtter Tesla fremdeles burde være flaue, ekstremt flaue.

-

Hele poenget med det du siterer har ikke med prestasjonen å gjøre. Det har med metoden det er implementert å gjøre. Det som du går glipp av er at selv om ID3,4 etc sitt system er dårligere enn Tesla sitt system, så fordrer det systemet at man aktivt kjører og holder hendene på rattet. Justerer du inn bilen, så går systemet i "standby" modus og aktiveres helt uten menneskelig innput. Du bare kjører som normalt og assisten fungerer i bakgrunnen. Volkswagen har aldri sagt at deres systemer allerede har hardware bra nok for full selvkjøring, der bremsene kun ligger hos regelverk. Det har heller ikke BMW, eller Audi, eller Mercedes, etc sagt. Det er kun hos Tesla hvor man finner et system som er implementert som om det er et nivå 3+ system, der CEO'en fremdeles later til at systemet er ved nivå 3+ mens det virkelig ikke er det.

-

Du sier at det er lovlig av man skal kunne slippe rattet idag. "å ha hendene av rattet er "lovlig", både på tesla sitt system og andre system." Det er altså ikke det lovverket sier. Her i Norge så skal man ha "full kontroll over kjøretøyet". System som tillater at man ikke holder hendene på rattet later til å ignorere regelverk, da det implisitt betyr at man ikke har full kontroll over kjøretøyet. Samme hardware. FSD er mer eller mindre kun en "rebrand" av hva Autopilot var, som så fikk litt mer til seg gjennom "Enhanced Autopilot", som så har fått litt mer til seg og blitt omdøpt til Full Self Driving. Spiller null rolle om bildegjenkjenningen er blitt bedre, eller om geofencingen har åpnet seg mer til å innkludere bykjøring. Både Autopilot og FSD inkluderte hovedingrediensene som altså er deres "autosteer" og "traffic-Aware Cruise Control".

-

https://worldpopulationreview.com/state-rankings/us-literacy-rates-by-state?utm_source=chatgpt.com